De manera predeterminada, Copilot Chat usa el modelo de lenguaje grande GPT 4o de OpenAI. Se trata de un modelo muy experto que funciona bien para las tareas de generación de texto, como las de resumen y chat basado en conocimiento. El modelo también es capaz de razonar, resolver problemas matemáticos complejos y programar.

Pero no tienes que limitarte a usar este modelo. Puedes elegir entre una selección de otros modelos, cada uno con sus propios puntos fuertes concretos. Es posible que tengas un modelo favorito que quieras usar o que prefieras utilizar un modelo determinado para preguntar sobre un tema específico.

Copilot te permite cambiar el modelo durante un chat y usar el modelo alternativo para generar respuestas a tu preguntas.

Note

- La compatibilidad con varios modelos en Copilot Chat se encuentra en versión preliminar pública y está sujeta a cambios.

- Solo puedes usar un modelo de IA alternativo en la vista envolvente de Copilot Chat. Esta es la versión de página completa de Copilot Chat que se muestra en https://github.com/copilot. En el panel de Copilot Chat siempre se usa el modelo predeterminado.

Modelo de IA para Copilot Chat

Los siguientes modelos están disponibles actualmente a través de Copilot Chat de varios modelos:

- GPT 4o: es el modelo de Copilot Chat predeterminado. Es un modelo versátil y bidireccional que destaca tanto en el procesamiento de texto como en la imagen y está diseñado para proporcionar respuestas rápidas y de confianza. También tiene un rendimiento superior en idiomas que no son inglés. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. GPT 4o se hospeda en Azure.

- Claude 3.5 Sonnet: este modelo destaca en las tareas de codificación durante todo el ciclo de vida de desarrollo de software, desde el diseño inicial hasta las correcciones de errores, pasando por el mantenimiento y las optimizaciones. Obtén más información sobre las funcionalidades del modelo o lee la tarjeta de modelo. GitHub Copilot usa Claude 3.5 Sonnet hospedado en Amazon Web Services.

- Gemini 2.0 Flash: este modelo tiene funcionalidades sólidas de programación, matemáticas y razonamiento que hacen que sea adecuado para facilitar el desarrollo de software. Para obtener información sobre las funcionalidades de Gemini 2.0 Flash, consulta el blog de Google para desarrolladores y la documentación de Google Cloud. Para obtener detales sobre la directiva de control de datos de Google, consulta La inteligencia artificial generativa y la gobernanza de datos en el sitio web de Google.

- o1: este modelo se centra en el razonamiento avanzado y la resolución de problemas complejos, en particular en matemáticas y ciencias. Responde más lentamente que el modelo GPT 4o. Puede realizar 10 solicitudes para este modelo al día. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. o1 se hospeda en Azure.

- o3-mini: este modelo es la próxima generación de modelos de razonamiento, después de o1 y o1-mini. El modelo o3-mini supera el rendimiento de o1 en las pruebas comparativas de programación con tiempos de respuesta que son comparables a los de o1-mini, lo que proporciona una calidad mejorada a casi la misma latencia. Es más adecuado para las operaciones de generación de código y contexto pequeño. Puedes realizar 50 solicitudes a este modelo cada 12 horas. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. o3-mini se hospeda en Azure.

Para más información sobre estos modelos, consulta lo siguiente:

- Modelos GPT 4o, o1 y o3-mini de OpenAI: Modelos en la documentación de la plataforma OpenAI.

- Modelo Claude 3.5 Sonnet de Anthropic: Uso de Claude 3.5 Sonnet en GitHub Copilot.

- Modelo Gemini 2.0 Flash de Google: Uso de Gemini 2.0 Flash en GitHub Copilot.

Limitaciones de los modelos de IA para Copilot Chat

- Si quieres usar las capacidades enumeradas en la tabla anterior, en el sitio web GitHub, solo se admiten los modelos GPT 4o, Claude 3.5 Sonnet y Gemini 2.0 Flash.

- Es posible que las versiones preliminares experimentales de los modelos no interactúen correctamente con todos los filtros, incluido el filtro de detección de duplicados.

Cambio del modelo de IA

Estas instrucciones son para Copilot en el sitio web de GitHub. Para Visual Studio o VS Code, haz clic en la pestaña correspondiente en la parte superior de esta página.

Si accedes a Copilot Chat a través de una suscripción de Copilot Business, tu organización debe conceder a sus miembros la capacidad de cambiar a un modelo diferente. Consulta Administración de directivas de Copilot para empresas en su organización.

Note

Si usa Copilot Extensions, puede invalidar el modelo que seleccione.

-

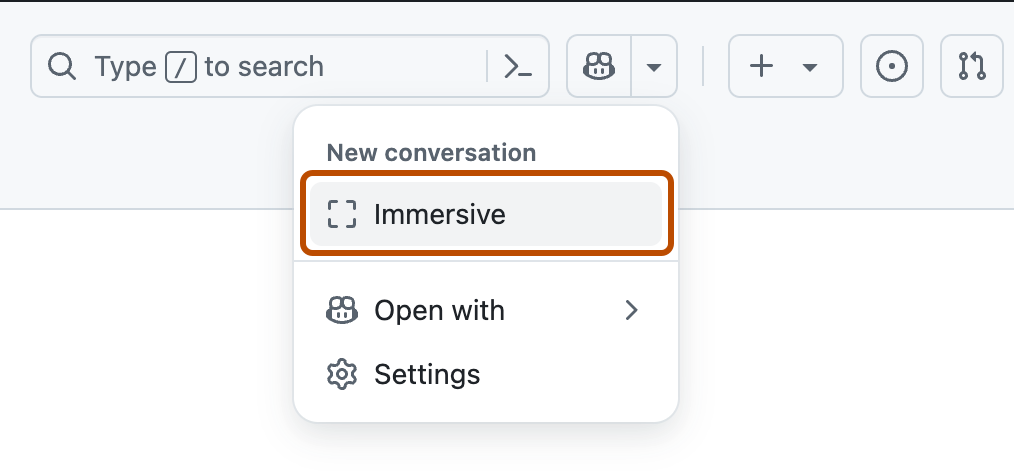

En la parte superior derecha de cualquier página de GitHub, haz clic en la flecha hacia abajo situada junto al icono y haz clic en Immersive en el menú desplegable.

-

En la parte superior de la vista envolvente, selecciona el menú desplegable CURRENT-MODEL y, después, haz clic en el modelo de IA que prefieras.

Note

La compatibilidad con varios modelos en Copilot Chat se encuentra en versión preliminar pública y está sujeta a cambios.

Modelo de IA para Copilot Chat

Los siguientes modelos están disponibles actualmente a través de Copilot Chat de varios modelos:

- GPT 4o: es el modelo de Copilot Chat predeterminado. Es un modelo versátil y bidireccional que destaca tanto en el procesamiento de texto como en la imagen y está diseñado para proporcionar respuestas rápidas y de confianza. También tiene un rendimiento superior en idiomas que no son inglés. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. GPT 4o se hospeda en Azure.

- Claude 3.5 Sonnet: este modelo destaca en las tareas de codificación durante todo el ciclo de vida de desarrollo de software, desde el diseño inicial hasta las correcciones de errores, pasando por el mantenimiento y las optimizaciones. Obtén más información sobre las funcionalidades del modelo o lee la tarjeta de modelo. GitHub Copilot usa Claude 3.5 Sonnet hospedado en Amazon Web Services.

- Gemini 2.0 Flash: este modelo tiene funcionalidades sólidas de programación, matemáticas y razonamiento que hacen que sea adecuado para facilitar el desarrollo de software. Para obtener información sobre las funcionalidades de Gemini 2.0 Flash, consulta el blog de Google para desarrolladores y la documentación de Google Cloud. Para obtener detales sobre la directiva de control de datos de Google, consulta La inteligencia artificial generativa y la gobernanza de datos en el sitio web de Google.

- o1: este modelo se centra en el razonamiento avanzado y la resolución de problemas complejos, en particular en matemáticas y ciencias. Responde más lentamente que el modelo GPT 4o. Puede realizar 10 solicitudes para este modelo al día. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. o1 se hospeda en Azure.

- o3-mini: este modelo es la próxima generación de modelos de razonamiento, después de o1 y o1-mini. El modelo o3-mini supera el rendimiento de o1 en las pruebas comparativas de programación con tiempos de respuesta que son comparables a los de o1-mini, lo que proporciona una calidad mejorada a casi la misma latencia. Es más adecuado para las operaciones de generación de código y contexto pequeño. Puedes realizar 50 solicitudes a este modelo cada 12 horas. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. o3-mini se hospeda en Azure.

Para más información sobre estos modelos, consulta lo siguiente:

- Modelos GPT 4o, o1 y o3-mini de OpenAI: Modelos en la documentación de la plataforma OpenAI.

- Modelo Claude 3.5 Sonnet de Anthropic: Uso de Claude 3.5 Sonnet en GitHub Copilot.

- Modelo Gemini 2.0 Flash de Google: Uso de Gemini 2.0 Flash en GitHub Copilot.

Cambio del modelo de IA

Estas instrucciones son para VS Code. Para Visual Studio o Copilot en el sitio web de GitHub, haz clic en la pestaña correspondiente en la parte superior de esta página.

Si accedes a Copilot Chat a través de una suscripción de Copilot Business, tu organización debe conceder a sus miembros la capacidad de cambiar a un modelo diferente. Consulta Administración de directivas de Copilot para empresas en su organización.

Note

- Si usa Copilot Extensions, puede invalidar el modelo que seleccione.

- Es posible que las versiones preliminares experimentales de los modelos no interactúen correctamente con todos los filtros, incluido el filtro de detección de duplicados.

- Para abrir la vista de chat, haga clic en el icono de chat de la barra de actividad o presione Control+Comando+i (Mac)/Ctrl+Alt+i (Windows/Linux).

- En la parte inferior derecha de la vista de chat, seleccione el menú desplegable CURRENT-MODEL y, a continuación, haga clic en el modelo de IA que prefiera.

Note

La compatibilidad con varios modelos en Copilot Chat se encuentra en versión preliminar pública y está sujeta a cambios.

Modelo de IA para Copilot Chat

De forma predeterminada, Copilot Chat usa el modelo GPT 4o. Dependiendo de la tarea en la que estés trabajando, es posible que quieras usar un modelo diferente, como el modelo de Claude 3.5 Sonnet o el modelo o1. Para ver una lista de todos los modelos de IA disponibles actualmente para Copilot Chat, así como las ventajas y limitaciones de cada modelo, consulta Hoja de referencia rápida de GitHub Copilot Chat.

Los siguientes modelos están disponibles actualmente a través de Copilot Chat de varios modelos:

- GPT 4o: es el modelo de Copilot Chat predeterminado. Es un modelo versátil y bidireccional que destaca tanto en el procesamiento de texto como en la imagen y está diseñado para proporcionar respuestas rápidas y de confianza. También tiene un rendimiento superior en idiomas que no son inglés. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. GPT 4o se hospeda en Azure.

- Claude 3.5 Sonnet: este modelo destaca en las tareas de codificación durante todo el ciclo de vida de desarrollo de software, desde el diseño inicial hasta las correcciones de errores, pasando por el mantenimiento y las optimizaciones. Obtén más información sobre las funcionalidades del modelo o lee la tarjeta de modelo. GitHub Copilot usa Claude 3.5 Sonnet hospedado en Amazon Web Services.

- o1: este modelo se centra en el razonamiento avanzado y la resolución de problemas complejos, en particular en matemáticas y ciencias. Responde más lentamente que el modelo GPT 4o. Puede realizar 10 solicitudes para este modelo al día. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. o1 se hospeda en Azure.

- o1-mini: esta es la versión más rápida del modelo o1, y equilibra el uso de razonamiento complejo con la necesidad de respuestas más rápidas. Es más adecuado para las operaciones de generación de código y contexto pequeño. Puede realizar 50 solicitudes para este modelo al día. Obtén más información sobre las funcionalidades del modelo y revisa la tarjeta de modelo. o1-mini se hospeda en Azure.

Para obtener más información sobre los modelos o1, consulta Modelos en la documentación de la plataforma OpenAI.

Para obtener más información sobre el modelo Claude 3.5 Sonnet de Anthropic, consulta Uso de Claude 3.5 Sonnet en GitHub Copilot.

Cambio del modelo de IA

Estas instrucciones son para Visual Studio. Para VS Code o Copilot en el sitio web de GitHub, haz clic en la pestaña correspondiente en la parte superior de esta página.

Para usar Copilot Chat de varios modelos, debes utilizar Visual Studio 2022 versión 17.12 o posterior. Consulta la página de descargas de Visual Studio.

Si accedes a Copilot Chat a través de una suscripción de Copilot Business, tu organización debe conceder a sus miembros la capacidad de cambiar a un modelo diferente. Consulta Administración de directivas de Copilot para empresas en su organización.

Note

- Si usa Copilot Extensions, puede invalidar el modelo que seleccione.

- Es posible que las versiones preliminares experimentales de los modelos no interactúen correctamente con todos los filtros, incluido el filtro de detección de duplicados.

- En la barra de menús de Visual Studio, haz clic en Ver y, luego, en GitHub Copilot Chat.

- En la parte inferior derecha de la vista de chat, selecciona el menú desplegable CURRENT-MODEL y, a continuación, haz clic en el modelo de IA que prefieras.